大家好,我是陈杨,8 年前端老兵转型鸿蒙开发,也是一名鸿蒙极客。从前端到鸿蒙,我靠的是 “三天上手 ArkTS” 的技术嗅觉,以及 “居安思危” 的转型魄力。

这三年,我不玩虚的,封装了开源组件库「莓创图表」,拿过创新赛大奖,更带着团队上架了 11 款自研 APP,涵盖工具、效率、创意等多个领域。

想体验我的作品?欢迎搜索体验:指令魔方、JLPT、REFLEX PRO、国潮纸刻、Wss 直连、ZenithDocs Pro、圣诞相册、CSS 特效。

之前给大家分享了指令魔方里用到的语音交互、OCR 文字识别和主体分割功能,今天换个赛道 —— 聊聊鸿蒙 Core Vision Kit 里的人脸检测能力。

虽然这个功能没用到指令魔方里,但它的应用场景特别广,比如美颜 APP 的人脸定位、相册的人脸聚类、安防场景的人脸检测等。

今天就用通俗的语言,带大家拆解它的实现逻辑,附上可直接复用的代码,新手也能快速上手开发。

先搞懂:人脸检测到底能做啥?

简单说,人脸检测就是 “让 APP 自动在图片里找到人脸,并且告诉你人脸的关键信息”。它不只是简单识别 “这是一张人脸”,还能给出很多实用数据,比如:

- 人脸位置:用矩形框标出人脸在图片里的具体坐标(左上角、宽高);

- 置信度:告诉你检测结果的靠谱程度(数值越高越准确)。

它的适用场景特别多,比如:

- 美颜 APP:根据五官位置精准添加滤镜、磨皮、大眼等效果;

- 相册分类:自动识别图片里的人脸,按人物聚类整理照片;

- 门禁安防:检测画面中是否有人脸,为后续的人脸识别做铺垫;

- 互动娱乐:根据人脸朝向控制游戏角色,或在人脸周围添加趣味贴纸。

不过要注意几个约束:目前不支持模拟器,必须用真实鸿蒙设备测试;图片质量要过关(建议 720p 以上),太模糊的图片可能检测失败;而且接口调用耗时稍久,不适合实时检测场景(比如直播实时美颜)。

核心逻辑:从 “选图” 到 “检测” 的 4 步走

人脸检测的开发流程和之前讲的 OCR、主体分割很相似,核心就 4 个步骤:

- 初始化人脸检测服务:打开检测功能的 “开关”,准备好所需资源;

- 图片格式转换:把选中的图片转换成人脸检测能识别的 PixelMap 格式;

- 调用检测接口:传入图片,等待检测结果,最后解析并显示人脸信息。

可直接复用的代码(简化实战版)

下面的代码是基于鸿蒙官方示例优化的简化版,去掉了复杂的冗余逻辑,保留了核心功能,新手可以直接复制到项目里使用。

// 导入需要的工具包import { faceDetector } from '@kit.CoreVisionKit';import { image } from '@kit.ImageKit';import { hilog } from '@kit.PerformanceAnalysisKit';import { BusinessError } from '@kit.BasicServicesKit';import { fileIo } from '@kit.CoreFileKit';import { photoAccessHelper } from '@kit.MediaLibraryKit';const TAG = "FaceDetectionDemo";@Entry@Componentstruct FaceDetectorPage { // 选中的原始图片(PixelMap格式) @State originalImage: PixelMap | undefined = undefined; // 检测结果信息(人脸个数、位置、五官等) @State detectionResult: string = "检测结果会显示在这里..."; // 图片资源对象 private imageSource: image.ImageSource | undefined = undefined; build() { Column({ space: 20 }) { // 显示原始图片 Image(this.originalImage) .objectFit(ImageFit.Contain) .height('40%') .width('90%') .border({ width: 2, color: 0x317AE7, radius: 8 }) .backgroundColor('#F5F5F5') .accessibilityDescription("待检测图片") // 显示检测结果(支持复制) Scroll() { Text(this.detectionResult) .copyOption(CopyOptions.LocalDevice) .margin(10) .width('90%') .fontSize(14) } .height('25%') .border({ width: 1, color: '#E0E0E0', radius: 8 }) .width('90%') // 选择图片按钮 Button('从图库选择图片') .type(ButtonType.Capsule) .backgroundColor(0x317AE7) .fontColor(Color.White) .width('90%') .height(45) .onClick(() => this.selectImageFromGallery()) // 开始检测按钮 Button('开始人脸检测') .type(ButtonType.Capsule) .backgroundColor(0x317AE7) .fontColor(Color.White) .width('90%') .height(45) .onClick(() => this.startFaceDetection()) } .padding(20) .width('100%') .height('100%') .justifyContent(FlexAlign.Center) } // 第一步:从图库选择图片 private async selectImageFromGallery() { try { const photoPicker = new photoAccessHelper.PhotoViewPicker(); const selectResult = await photoPicker.select({ MIMEType: photoAccessHelper.PhotoViewMIMETypes.IMAGE_TYPE, // 只选图片 maxSelectNumber: 1 // 最多选1张 }); const imageUri = selectResult.photoUris[0]; if (imageUri) { await this.loadImageToPixelMap(imageUri); // 转换图片格式 } else { this.detectionResult = "未选中图片,请重新选择"; } } catch (err: BusinessError | any) { hilog.error(0x0000, TAG, `选图失败:${err.message}`); this.detectionResult = `选图失败:${err.message}(错误码:${err.code})`; } } // 第二步:将图片转换为人脸检测能识别的PixelMap格式 private async loadImageToPixelMap(uri: string) { try { // 打开图片文件 const file = await fileIo.open(uri, fileIo.OpenMode.READ_ONLY); // 创建图片资源对象 this.imageSource = image.createImageSource(file.fd); // 转换为PixelMap格式 this.originalImage = await this.imageSource.createPixelMap(); // 关闭文件,避免资源泄露 await fileIo.close(file); // 重置结果 this.detectionResult = "已选中图片,点击「开始人脸检测」按钮..."; } catch (err: BusinessError | any) { hilog.error(0x0000, TAG, `图片加载失败:${err.message}`); this.detectionResult = `图片加载失败:${err.message}`; } } // 第三步:初始化服务并调用人脸检测接口 private async startFaceDetection() { // 先判断是否选中了图片 if (!this.originalImage) { this.detectionResult = "请先选择一张图片!"; return; } try { // 初始化人脸检测服务 await faceDetector.init(); this.detectionResult = "正在检测人脸,请稍候..."; // 配置检测参数:传入待检测的图片(PixelMap格式) const visionInfo: faceDetector.VisionInfo = { pixelMap: this.originalImage }; // 调用检测接口,获取结果 const faceResult: faceDetector.Face[] = await faceDetector.detect(visionInfo); // 解析检测结果 if (faceResult.length === 0) { this.detectionResult = "未在图片中检测到人脸,请选择包含清晰人脸的图片"; } else { let resultText = `共检测到 ${faceResult.length} 个人脸\n\n`; // 遍历每个人脸,解析详细信息 faceResult.forEach((face, index) => { resultText += `=== 人脸 ${index + 1} 详细信息 ===\n`; // 1. 人脸位置(矩形框坐标) const faceRect = face.faceRectangle; resultText += `人脸位置:\n`; resultText += `左上角X:${faceRect.left.toFixed(2)},Y:${faceRect.top.toFixed(2)}\n`; resultText += `宽度:${faceRect.width.toFixed(2)},高度:${faceRect.height.toFixed(2)}\n`; // 2. 人脸置信度(0-1,越接近1越准确) resultText += `检测置信度:${face.confidence.toFixed(4)}(数值越高越准确)\n`; // 3. 人脸朝向(基于世界坐标系判断) resultText += `人脸朝向:${this.getFaceOrientation(face.orientation)}\n`; // 4. 五官位置(如果有数据则显示) if (face.faceFeatures) { resultText += `五官位置:\n`; resultText += `左眼:X=${face.faceFeatures.leftEye.x.toFixed(2)},Y=${face.faceFeatures.leftEye.y.toFixed(2)}\n`; resultText += `右眼:X=${face.faceFeatures.rightEye.x.toFixed(2)},Y=${face.faceFeatures.rightEye.y.toFixed(2)}\n`; resultText += `鼻子:X=${face.faceFeatures.nose.x.toFixed(2)},Y=${face.faceFeatures.nose.y.toFixed(2)}\n`; resultText += `嘴巴:X=${face.faceFeatures.mouth.x.toFixed(2)},Y=${face.faceFeatures.mouth.y.toFixed(2)}\n`; } resultText += "\n"; }); // 显示解析后的结果 this.detectionResult = resultText; } // 检测完成后释放服务,避免占用内存 await faceDetector.release(); } catch (error: BusinessError) { // 处理错误 this.detectionResult = `检测失败:${error.message}(错误码:${error.code})`; hilog.error(0x0000, TAG, `检测失败:${error.message},错误码:${error.code}`); // 出错后也释放服务 await faceDetector.release(); } } // 辅助函数:将人脸朝向枚举转换为通俗描述 private getFaceOrientation(orientation: number): string { // 鸿蒙人脸朝向基于世界坐标系,不同数值对应不同方向 switch (orientation) { case 0: return "正面朝上(正常方向)"; case 1: return "逆时针旋转90度"; case 2: return "旋转180度(倒立)"; case 3: return "顺时针旋转90度"; default: return "未知朝向"; } }}

代码关键部分解析

1. 初始化与释放:faceDetector.init() 初始化服务,faceDetector.release() 释放资源,这两步一定要成对出现,避免内存泄漏;2. 图片处理:和之前的功能一样,人脸检测只支持 PixelMap 格式,所以必须通过 image.createImageSource 转换图片,而且转换后要关闭文件(fileIo.close);faceResult.length:检测到的人脸个数;

face.faceRectangle:人脸矩形框坐标,可用于在图片上画框标记人脸;

face.confidence:置信度,0-1 之间,数值越高说明检测结果越靠谱;

face.orientation:人脸朝向,0-3 分别对应不同旋转方向,用辅助函数转换成通俗描述;

face.faceFeatures:五官位置,包含左眼、右眼、鼻子、嘴巴的坐标,是美颜、贴纸等功能的核心数据;

4. 错误处理:检测过程中可能出现图片格式错误、服务初始化失败等问题,用 try-catch 捕获并显示错误信息,同时释放服务。实战效果演示

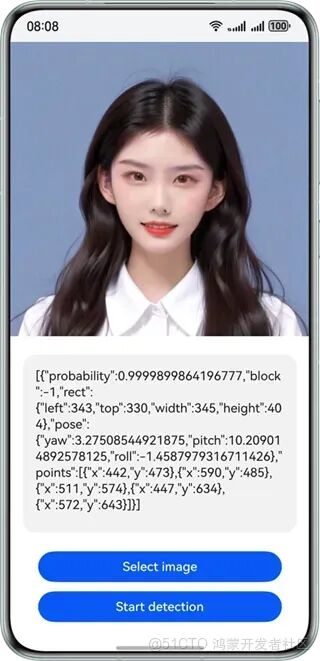

给大家看看实际的使用流程,更直观:

避坑指南:这些问题一定要注意

- 设备支持:不支持模拟器!必须用真实的鸿蒙手机、平板测试,否则会报 “服务不可用”;

- 图片质量:图片分辨率建议 720p 以上,宽度 100px-10000px,高度 224px-15210px,高宽比例不要超过 10:1(比如不要用特别细长的图片);

- 实时性:接口调用耗时稍久,不适合实时场景(比如摄像头实时检测),适合图片离线检测;

- 资源释放:不管检测成功还是失败,都要调用

faceDetector.release() 释放服务,否则会占用设备资源; - 五官数据:部分模糊图片可能检测不到五官,

face.faceFeatures 会为空,代码里要做判空处理,避免崩溃。

数据安全:用户的人脸数据怎么处理?

和鸿蒙其他视觉服务一样,人脸检测也特别注重隐私保护:

- 处理过程在本地完成:用户的图片和人脸数据不会上传到云端,全程在设备本地进行检测;

- 不存储用户数据:检测完成后,鸿蒙服务不会留存任何人脸信息,数据完全由 APP 控制;

- 权限友好:不需要额外申请敏感权限,调用系统图库和人脸检测服务,鸿蒙已经默认处理了权限问题。

如果你的 APP 要用到人脸检测功能,建议在隐私政策里告知用户 “人脸数据仅在本地处理,不会上传云端”,让用户更放心。

开发总结:新手也能快速落地

人脸检测的开发难度不高,核心流程和 OCR、主体分割高度相似,只要掌握了 “选图 - 转格式 - 调用接口 - 解析结果” 的套路,半天就能落地功能。

如果想扩展功能,还可以加这些:

- 人脸标记:在图片上用矩形框画出检测到的人脸,用小点标记五官位置;

- 人脸筛选:只保留置信度高于 0.8 的人脸结果,过滤掉模糊、误检测的情况;

- 互动功能:根据人脸朝向自动旋转图片,或在人脸周围添加趣味贴纸;

- 批量检测:支持选择多张图片,批量进行人脸检测并整理结果。

虽然人脸检测没用到指令魔方里,但它的实用价值很高,很多鸿蒙 APP 都能用到。如果你正在开发需要人脸相关的功能,直接拿上面的代码改一改就能用。